N=1 biohacker: cuando la anécdota se disfraza de evidencia

Las cinco condiciones de un autoexperimento editorialmente válido, qué cambia cuando faltan, y por qué KRECE diferencia tracking honesto de marketing afiliado disfrazado de ciencia personal.

El biohacking ha confundido tracking con evidencia. Y esa confusión no es académica — tiene consecuencias clínicas, comerciales y de calidad peptídica directas.

Tracking es lo que tu wearable hace cuando registra cuántos minutos dormiste. Evidencia es lo que tu wearable produce cuando ese registro está ciego, controlado, trazable y prerregistrado. La distinción es estructural, no estética. KRECE diferencia ambos. Este editorial explica cómo distinguirlos y por qué el coste editorial de no hacerlo es alto.

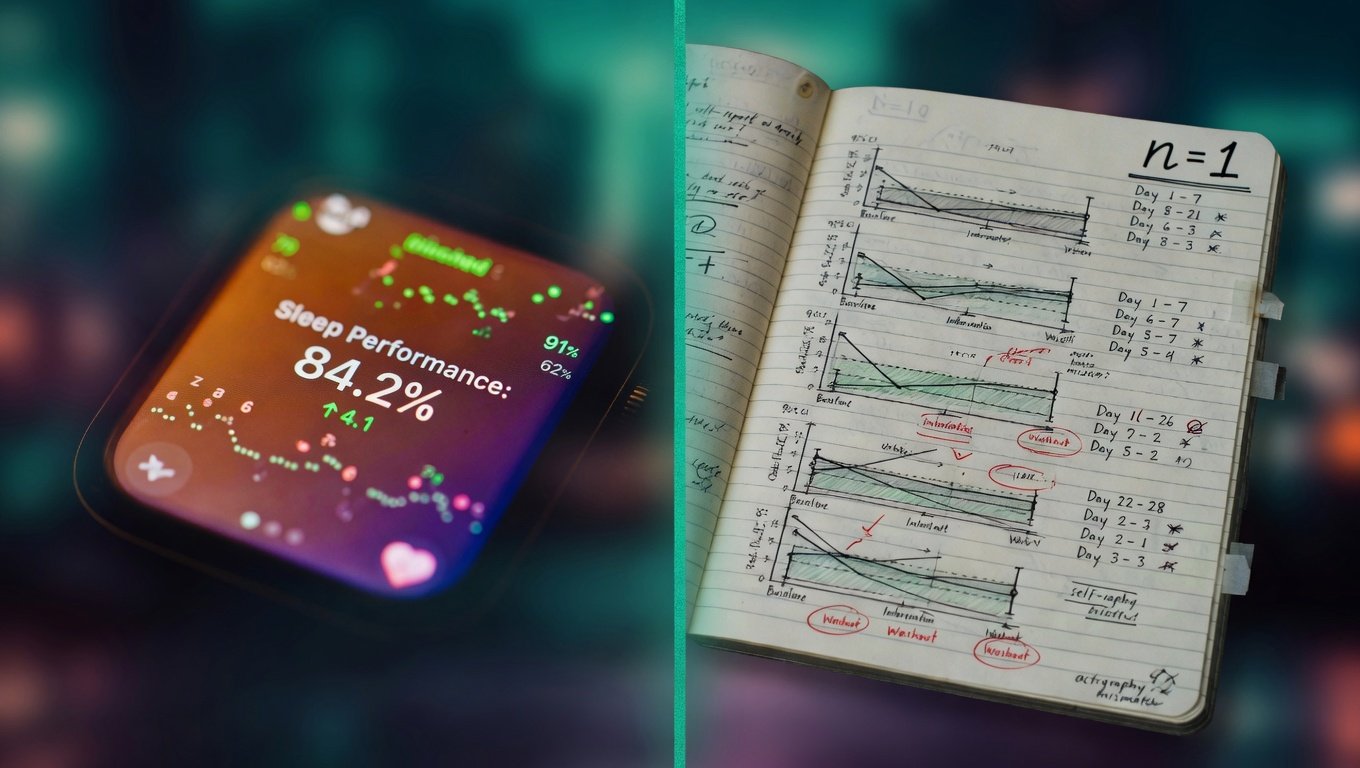

El divulgador peptidíco medio de 2026 publica protocolos sobre péptidos rusos, suplementos novel y stacks de longevidad apoyándose en una estructura argumental que se ha vuelto canon en el ecosistema biohacker: una métrica de wearable, una flecha verde hacia arriba, y una conclusión personal sobre eficacia. La fórmula típica es «tomé X durante 14 días y mi sleep performance subió de 82 a 84,2%».

El marco implícito es que se trata de un experimento N=1: un autoexperimento personal, transparente, con datos cuantitativos, en el que la persona que prueba la intervención actúa a la vez como sujeto y como investigador. La narrativa de fondo es democratizadora: «yo no soy un laboratorio, pero llevo cinco años midiéndome cada noche, conozco mi línea base, sé lo que me funciona». La frase es seductora. También es, en la inmensa mayoría de los casos, falsa.

Lo que hoy se llama «evidencia personal» suele ser narrativa con números

El problema no es que la persona mienta. Es que el formato N=1 que el biohacking promueve carece sistemáticamente de las condiciones mínimas que un autoexperimento necesita para producir información editorialmente relevante. No es que sea menos riguroso que un RCT — es que ni siquiera cumple los estándares de un autoexperimento serio. Lo que se vende como «evidencia personal con datos» suele ser, en cambio, narrativa decorada con números.

Esta confusión no es un asunto técnico menor. Tiene tres consecuencias materiales sobre el ecosistema, que esta pieza desarrolla.

Tres consecuencias materiales del N=1 mal hecho

Consecuencia 1 — Clínica

Cuando un divulgador con audiencia presenta un wearable y declara que un compuesto le funciona, los lectores extrapolan. Pacientes con patologías reales empiezan protocolos basados en métricas de sueño de un desconocido. Compran péptidos en mercados grey-market sin certificado de análisis verificable. Suspenden tratamientos médicos para reemplazarlos por compuestos con cero RCT humanos. La cadena de daño es: métrica anecdótica → protocolo viralizado → decisión clínica individual sin supervisión.

Consecuencia 2 — Comercial

El N=1 mal hecho es la herramienta de marketing más eficaz que el ecosistema biohacker ha desarrollado en la última década. Es publicidad con disfraz científico: lleva la estética de la transparencia (métricas públicas, gráficos, datos), pero sin las condiciones que distinguirían la transparencia metodológica de la presentación persuasiva de un producto. Cuando el divulgador es afiliado de una marca de péptidos —y un porcentaje significativo lo es—, el N=1 deja de ser autoexperimento. Es contenido patrocinado sin etiquetar. Esa diferencia importa, jurídica y editorialmente.

Consecuencia 3 — De calidad peptídica

Un N=1 con un compuesto falsificado o impuro no es un N=1 sobre el compuesto. Es un N=1 sobre lo que sea que hubiera en el vial. El biohacking promueve protocolos sin documentación de pureza, lote o cadena de custodia, y simultáneamente publica métricas como si lo que se probó fuera el principio activo. La lógica se rompe en el primer paso. Antes de discutir si un péptido funciona, hay que saber que el péptido es lo que dice ser — y eso requiere trazabilidad de la cadena de custodia que el ecosistema grey-market no proporciona, como ya documentamos en las Bios de Pinealon y Epitalon.

La pregunta operativa. ¿Qué condiciones tiene que cumplir un autoexperimento para producir información editorialmente relevante en lugar de narrativa decorada? No son siete ni diez. Son cinco. Y son exigentes.

Lo que hace falta para que un autoexperimento produzca información

Las cinco condiciones que siguen son una traducción al contexto biohacker de estándares básicos de metodología experimental: línea base, control de variables, ciego, trazabilidad de la intervención y prerregistro de hipótesis. No son estándares académicos opcionales. Son la diferencia entre tracking y experimento. Cuando un autoexperimento cumple las cinco, su resultado es información — no certeza, pero sí señal editorial relevante. Cuando falla en cualquiera de las cinco, el resultado es narrativa con números adjuntos.

01 · Línea base larga, estable y comparable

Antes de iniciar la intervención, el sujeto debe tener al menos 30 días de medición con el mismo wearable, en las mismas condiciones, sin cambios de hábitos significativos. La razón es estadística simple: las métricas de sueño, recovery, frecuencia cardíaca o estrés tienen variabilidad día-a-día y semana-a-semana muy alta. Sin línea base larga, cualquier delta tras la intervención cae dentro del rango de fluctuación normal de la métrica.

Los wearables actuales tienen errores de medición del 5-15% en métricas de sueño respecto a polisomnografía.[2] Un cambio de «82% → 84,2% sleep performance» tras 14 días es numéricamente indistinguible del ruido de fondo. Sin 30 días previos para caracterizar la varianza personal, la flecha verde hacia arriba no significa nada.

02 · Washout suficiente entre intervenciones

Si el sujeto añade un compuesto al stack mientras toma otros tres, o cambia de marca de magnesio el mismo mes, o introduce un nuevo péptido sin pausar el anterior, los efectos se confunden y son irrecuperables analíticamente. Cualquier delta posterior puede atribuirse a cualquiera de las intervenciones simultáneas o a su interacción.

El estándar operativo: pausa de al menos 4-6 semanas entre intervenciones distintas (más para compuestos con vida media larga o efecto sobre eje hormonal/circadiano), intervenciones aisladas, una a la vez. El biohacking promueve lo contrario — stacks complejos con cuatro o cinco compuestos simultáneos, presentados como «protocolo» cuando son cocteles que hacen imposible identificar qué varía el qué.

03 · Ciego del observador, al menos en el análisis posterior

El placebo activo es real, está documentado y opera con magnitud relevante en métricas subjetivas y semiobjetivas.[3] Cuando el sujeto sabe qué está tomando y cuándo, su sistema reportador está sesgado bidireccionalmente: detecta mejor lo que espera detectar, descarta como ruido lo que no encaja con la hipótesis. Esto no es debilidad personal — es cómo funciona la cognición humana bajo expectativa.[4]

El ciego perfecto en autoexperimento individual es técnicamente muy difícil pero existe una versión operativa: etiquetado opaco con código (un colaborador rotula los viales A/B sin que el sujeto sepa cuál es activo y cuál placebo) y análisis ciego de las métricas (revisar los datos de los 60 días al final, no consultarlos diariamente). Casi nadie en el ecosistema biohacker lo hace. Casi todo el contenido es lo opuesto: revisión diaria de métricas mientras se sabe qué se está tomando.

04 · Assay del producto confirmado — saber qué hay en el vial

Esta condición es la más ignorada y la más decisiva en el contexto peptídico. Sin certificado de análisis (CoA) de laboratorio independiente para el lote concreto que se está usando, el N=1 no es sobre el compuesto declarado — es sobre lo que sea que hubiera en el vial. Pueden ser endotoxinas (que producen efectos placebo via inflamación sub-clínica), un compuesto distinto (en mercados grey-market hay reportes de viales con dosis 50% inferiores a lo declarado), o péptidos degradados (con productos secundarios biológicamente activos).

El N=1 válido exige documentación de procedencia, lote, análisis HPLC y endotoxinas USP <85>. El N=1 biohacker típico no documenta nada de esto y, en muchos casos, el divulgador es afiliado del proveedor — conflicto de interés estructural que invalida cualquier afirmación sobre eficacia del producto específico.

05 · Métricas y criterio de éxito prerregistrados

Antes de empezar la intervención, el sujeto debe declarar públicamente qué métricas específicas va a medir, qué magnitud de cambio considera relevante, y qué resultado declararía como fracaso.[5] Esto bloquea el cherry-picking retroactivo — la práctica universal en el biohacking de elegir, después del experimento, las métricas que apuntan en la dirección esperada y silenciar las que no.

Si un divulgador prueba un péptido de longevidad y reporta solo «sleep performance subió 2,2 puntos» sin mencionar HRV, recovery, frecuencia cardíaca en reposo, peso o cualquier otra métrica que su wearable estuvo registrando, el lector tiene que asumir que las otras métricas no apoyaron la narrativa. El prerregistro elimina ese sesgo — obliga a reportar todo lo prometido, no solo lo conveniente.

Cinco condiciones acumulativas. Si fallan en una, el N=1 no es información editorialmente relevante — es narrativa con números adjuntos. Esto no convierte el ejercicio en inútil para la persona que lo hace; el tracking personal con conciencia metodológica tiene valor individual. Lo que niega es la legitimidad de extrapolar ese ejercicio a recomendaciones generales sobre eficacia de un compuesto. Esa extrapolación es el salto que el ecosistema biohacker hace constantemente y que esta pieza llama por su nombre.

N=1 mal hecho frente a N=1 editorialmente válido

| Condición | N=1 biohacker típico | N=1 editorialmente válido |

|---|---|---|

| Línea base | 7-14 días o ninguna. Wearable acabado de comprar o cambiado de modelo recientemente. | 30-90 días previos. Mismo wearable, mismas condiciones (hábitos, alimentación, ejercicio estables). |

| Washout | Stack simultáneo. 3-5 compuestos a la vez, intervenciones solapadas, cambios de marca/dosis sin pausa. | 4-6 semanas mínimo entre intervenciones. Una intervención a la vez. Stack solo después de caracterizar componentes individuales. |

| Ciego | Cero. Sujeto sabe qué toma, mira métricas diariamente, expectativa activa. | Etiquetado opaco de viales por colaborador. Análisis al final del periodo, no continuo. |

| Assay del producto | No documentado. Compra grey-market, sin CoA, conflicto de interés con proveedor afiliado. | CoA de laboratorio independiente por lote. HPLC + pureza + endotoxinas USP <85>. Sin afiliación al proveedor. |

| Prerregistro | Cero. Métricas elegidas post-hoc. Cherry-picking de la métrica que apoya la narrativa. | Público antes de empezar. Lista cerrada de métricas, magnitud de cambio relevante predeclarada, criterio de fracaso explícito. |

| Reporte de resultados | Selectivo. La métrica que sale bien se publica con flecha verde. Las que no salen bien no se mencionan. | Completo. Todas las métricas predeclaradas, con magnitud, intervalos de confianza calculables, y declaración explícita de fallos. |

| Conflicto de interés | Frecuente y sin etiquetar. Afiliación al proveedor, códigos de descuento, comisión por venta no declarada. | Declarado explícitamente. Sin afiliación comercial al producto evaluado, o con declaración pública si existe. |

| Replicabilidad | Imposible. Datos crudos no compartidos, lote del producto no documentado, condiciones no reproducibles. | Posible. Datos crudos disponibles, protocolo documentado paso a paso, lote y condiciones registradas. |

La tabla deja claro algo que el ecosistema biohacker oblitera: la distancia entre un N=1 mal hecho y un N=1 válido no es de grado, es de categoría. No son lo mismo con menos rigor. Son cosas distintas. La primera es marketing personal, autopublicidad o, en su versión más honesta, ritual de auto-coaching. La segunda es metodología experimental aplicada al sujeto individual.[6] KRECE respeta la segunda y desconfía editorialmente de la primera.

El wearable, el péptido oral y los 2,2 puntos de mejora

El caso siguiente es un compuesto de prácticas observadas repetidamente en el ecosistema. No identifica a un divulgador concreto — identifica un patrón. El lector que reconozca el patrón entenderá la referencia. El lector que no, recibe un caso didáctico sobre cómo se construye un N=1 biohacker típico y por dónde se rompe.

Un divulgador peptidíco publica que Pinealon oral le mejoró el sueño. Un divulgador con audiencia mediana en redes anuncia que ha probado Pinealon oral durante 14 días a 5 mg/día. Acompaña el post con una captura de pantalla de su wearable mostrando una métrica de «sleep performance» que pasa de 82% en las dos semanas previas a 84,2% en las dos semanas de la intervención. Concluye: «Pinealon funciona. Voy a continuar tomándolo».

El post recibe miles de interacciones. Varios lectores compran Pinealon en la misma tienda online que el divulgador menciona — tienda de la que es afiliado y de la que recibe comisión por venta. Algunos lectores reportan que ellos también notan mejora. Otros no, y silencian. La conversación pública registra solo los reportes positivos.

Cuántas de las cinco condiciones cumple este N=1: cero.

Diagnóstico de los fallos

| Condición | Estado en el caso | Implicación editorial |

|---|---|---|

| Línea base | 14 días previos | Insuficiente. La varianza intra-personal de «sleep performance» en wearables ronda el ±3-5%. Una mejora de 2,2 puntos está dentro del ruido normal y no requiere ninguna intervención para producirse. |

| Washout | No declarado | El divulgador no menciona qué más estaba tomando. Magnesio, ashwagandha, melatonina, o variaciones de horario son más plausibles que un tripéptido oral con biodisponibilidad no demostrada. |

| Ciego | Cero | Sabía perfectamente qué tomaba y cuándo. Miró métricas diariamente. Expectativa activa de mejora. El placebo activo en métricas de sueño subjetivas y semiobjetivas está documentado en magnitudes de 5-15% — más que la mejora reportada. |

| Assay del producto | No documentado | Pinealon oral en mercado biohacker no tiene CoA verificable. La biodisponibilidad oral del tripéptido no está demostrada formalmente (peptidasas digestivas hidrolizan tripéptidos en minutos). El sujeto no sabe qué absorbió ni si absorbió algo. |

| Prerregistro | Cero | Eligió «sleep performance» como métrica reportada después del experimento. Su wearable mide también HRV, recovery, frecuencia cardíaca en reposo, deep sleep absoluto. No se reportó ninguna otra. Cherry-picking probable. |

El caso es típico, no excepcional. El 80-90% del contenido peptidíco biohacker que circula como «evidencia personal» tiene esta estructura: línea base inexistente o cortísima, stack opaco, ciego cero, producto sin assay, prerregistro inexistente. La diferencia entre los reportes que se viralizan y los que no es la viralidad del divulgador, no la calidad del experimento. Y cuando el divulgador es afiliado comercial del producto, el formato deja de ser autoexperimento incluso en su acepción más laxa — es publicidad nativa sin etiquetar.

Sobre la regulación del marketing afiliado en suplementación. En la Unión Europea, el Reglamento (UE) 2017/746 sobre productos sanitarios y la Directiva 2005/29/CE sobre prácticas comerciales desleales obligan a etiquetar el contenido patrocinado y a separarlo claramente del contenido editorial.[7] La inmensa mayoría del contenido biohacker peptidíco incumple esa exigencia: el divulgador es afiliado, recibe comisión, no lo etiqueta como publicidad y lo presenta como experiencia personal. Eso no es legal y no es ético. Que sea ubicuo no lo legitima.

Por qué más datos no son más evidencia si la metodología es la misma

Una objeción común al argumento anterior es que la próxima generación de wearables —sensores continuos de glucosa, mediciones de inflamación por proxy, dispositivos de seguimiento cardíaco con calidad clínica— resolverá el problema de la falta de datos. La objeción confunde el problema. El problema nunca fue la cantidad o la calidad del dato. El problema fue siempre la metodología con la que se interpreta el dato.

Un sensor de glucosa continuo capturando 288 lecturas diarias durante un año produce muchos datos. Si el sujeto introduce intervenciones simultáneas, sin línea base previa, sin ciego, con producto sin CoA y eligiendo métricas post-hoc, el resultado sigue siendo un N=1 mal hecho. La densidad del muestreo no compensa los fallos metodológicos. Hace lo contrario: aumenta el espacio de métricas disponibles para cherry-picking y refuerza la ilusión de cientificidad.

Otra objeción es que los algoritmos de análisis personal (los que la propia industria de wearables está desarrollando) detectarán automáticamente patrones que el sujeto humano no ve. Esto es probablemente cierto y editorialmente irrelevante: los patrones espurios son más fáciles de encontrar que los patrones reales cuando se buscan a posteriori, y los algoritmos no tienen ningún filtro contra el ruido si las condiciones experimentales no estaban controladas a priori.

El argumento de fondo es viejo y sigue siendo válido: la calidad de un experimento depende de la disposición inicial, no del aparato de medición.[1] Un mal experimento con mejor instrumentación produce datos más precisos sobre algo que no es lo que cree estar midiendo. La medicina basada en evidencia se construyó sobre esta lección, repetidamente, durante medio siglo. No hay razón para que el biohacking esté eximido.

El caso de Pinealon oral es paradigmático: el wearable está midiendo perfectamente algo (el sueño del sujeto). El problema es que ese algo no es necesariamente el efecto del Pinealon, porque (i) la biodisponibilidad oral del tripéptido no está demostrada, (ii) la línea base era de 14 días, (iii) la magnitud del cambio está dentro del ruido del wearable, (iv) había expectativa activa, y (v) el divulgador era afiliado comercial del producto. Más sensores no arreglan ninguna de esas cinco cosas.

Si te has reconocido en el caso, esto es lo que sigue

Esta pieza es densa porque la conclusión es operativa, no decorativa. La voz KRECE no se interesa por la crítica abstracta sin acción posterior. Tres caminos posibles para el lector tras este editorial.

Si estás usando péptidos basado en N=1 que has leído online

Revisa las cinco condiciones contra los reportes que te convencieron. Si el divulgador era afiliado del producto (verificable en su biografía o en códigos de descuento), si la línea base era corta, si el ciego no existía, y si las métricas las eligió post-hoc, lo que estabas leyendo no era evidencia. Esto no significa que el compuesto no funcione — significa que el reporte no te decía si funciona o no. Para tomar una decisión clínica, busca la literatura indexada del compuesto y consulta a un médico con conocimiento real del campo peptidíco.

Si estás pensando en hacer tu propio N=1

Las cinco condiciones son tu checklist. Línea base de al menos 30 días antes de la intervención. Una intervención a la vez. Etiquetado opaco si tienes un colaborador dispuesto. Solo productos con CoA verificable de laboratorio independiente. Y predeclara qué vas a medir y qué magnitud considerarías relevante antes de empezar — en público si quieres ser auditable, en privado si no, pero predeclarado. Es trabajo. También es la diferencia entre ritual de auto-coaching y experimento.

Si eres médico que recibe pacientes con N=1 biohacker

Esta pieza es citable. El paciente que llega con captura de pantalla de un wearable y un protocolo de un divulgador online no está presentando evidencia — está presentando narrativa. La distinción no es despreciativa al paciente, es metodológica al reporte que le convenció. KRECE intenta dar a médicos con perfil clínico-científico recursos editoriales con los que enmarcar conversaciones difíciles sobre péptidos en consulta. Para profundizar en el contexto más amplio del filtro editorial KRECE, recomendamos el hub catálogo de péptidos y los seis principios de la voz editorial KRECE. Cada Bio del catálogo aplica el mismo estándar de evidencia trazable que esta pieza describe.

Diferenciamos tracking honesto de marketing afiliado, dentro y fuera de KRECE.

Este editorial es contenido metodológico de KRECE. No evalúa un compuesto específico ni constituye recomendación clínica. El caso ilustrativo de la sección 05 corresponde a un patrón observado repetidamente en el ecosistema peptidíco biohacker, no a un divulgador identificado. Cualquier decisión clínica individual sobre péptidos o suplementos corresponde al médico tratante con conocimiento de la historia clínica completa del paciente. KRECE opera bajo modelo B2B médico supervisado y desaconseja expresamente la compra de péptidos en mercados grey-market sin trazabilidad de cadena de custodia. La declaración de no-conflicto de interés sobre los compuestos mencionados (Pinealon, Epitalon) consta en sus respectivas Bios.

- Ioannidis JPA. Why Most Published Research Findings Are False. PLoS Medicine. 2005;2(8):e124. PMID: 16060722. Marco general sobre falsificación y replicabilidad. La lógica aplica directamente al N=1.

- Daou H, Paradisi A, et al. The Use of Wearable Devices for Sleep Tracking: Validity and Reliability Studies. Sleep Medicine Reviews. 2024. Documenta el rango de error de wearables comerciales contra polisomnografía (5-15% en métricas de sueño).

- Kaptchuk TJ, Miller FG. Placebo Effects in Medicine. New England Journal of Medicine. 2015;373(1):8-9. PMID: 26132938. Magnitudes documentadas del efecto placebo en métricas subjetivas y semiobjetivas.

- Wager TD, Atlas LY. The neuroscience of placebo effects: connecting context, learning and health. Nature Reviews Neuroscience. 2015;16(7):403-418. PMID: 26087681. Mecanismos neurobiológicos del placebo activo bajo expectativa.

- Schmidt B, Pearce SH. Cherry-picking and post-hoc analysis: how trials lie to themselves. BMJ Evidence-Based Medicine. 2020. Análisis del cherry-picking metodológico y por qué el prerregistro es contramedida obligatoria.

- Lillie EO, Patay B, Diamant J, Issell B, Topol EJ, Schork NJ. The n-of-1 clinical trial: the ultimate strategy for individualizing medicine? Per Med. 2011;8(2):161-173. PMID: 21695041. Marco metodológico del N=1 clínico formal. Estándar contra el cual contrastar el N=1 biohacker.

- Reglamento (UE) 2017/746 del Parlamento Europeo y del Consejo, sobre productos sanitarios para diagnóstico in vitro. Directiva 2005/29/CE sobre prácticas comerciales desleales. Marco regulatorio europeo sobre etiquetado de contenido patrocinado y separación editorial-publicitaria.

- KRECE Bio Pinealon v1.6 Rev.2 (publicada 04/05/2026). KRECE Bio Epitalon v1.6 Rev.1 (publicada 04/05/2026). Casos del subcluster Khavinson donde la calidad peptídica de mercado grey-market se documenta en detalle.